Pada pagi hari tanggal 14 November 2019, Dr. Shen Xiangyang, wakil presiden eksekutif global Microsoft yang telah melayani Microsoft selama 23 tahun, mengumumkan pengunduran dirinya dari Microsoft; pada tanggal 5 Maret 2020, Universitas Tsinghua mengadakan acara online "Upacara Penunjukan Profesor Pengangkatan Ganda Shen Xiangyang dan Angin Musim Semi Kuliah keempat di ruang kuliah ", keberadaan pertama Dr. Shen Xiangyang setelah meninggalkan Microsoft dikonfirmasi. Setelah pertemuan, Shen Xiangyang menyampaikan pidato dalam bahasa Inggris semua tentang "Bagaimana Merancang dan Membangun AI yang Bertanggung Jawab", dan InfoQ memilah konten utama.

Karena dampak epidemi, Profesor Shen Xiangyang tidak dapat menjangkau tempat kejadian. Acara ini menggunakan bentuk siaran langsung online antara dua tempat dan disiarkan langsung melalui akun stasiun B Aula Kuliah Chunfeng Universitas Tsinghua. Pada tahun 2005, Shen Xiangyang mengajar di Universitas Tsinghua sebagai guru yang bekerja ganda. Pada tahun 2015, ia berpartisipasi dalam Global Innovation Institute (GIX) yang didirikan bersama oleh Tsinghua, Universitas Washington dan Microsoft.

Oleh karena itu, siaran langsung online ini adalah upacara pembaruan. Wakil Presiden Universitas Tsinghua Yang Bin memimpin upacara penghargaan. Presiden Qiu Yong memberikan pidato sebelum acara dan menyambut kedatangan Profesor Shen Xiangyang. Kemudian, Shen Xiangyang mengungkapkan keyakinannya dalam pengembangan kecerdasan buatan di Tiongkok dalam pidatonya, dan dia juga berharap dapat bekerja dan tinggal dengan guru dan siswa di Taman Tsinghua sesegera mungkin.

Qiu Yong, Presiden Universitas Tsinghua, secara resmi mengeluarkan surat pengangkatan untuk Shen Xiangyang

Setelah upacara, Shen Xiangyang memberikan ceramah online dan berbagi penelitian dan pandangannya tentang masalah terkait interpretabilitas AI dan bias AI.

Karena pidatonya dalam bahasa Inggris, InfoQ telah mengumpulkan konten utama untuk referensi oleh pengembang.

Shen Xiangyang: Bagaimana merancang dan membangun AI yang bertanggung jawab

Topik 1: Penjelasan AI

Sebelumnya, AI yang kita bicarakan muncul dalam fiksi ilmiah atau film. Faktanya, AI kini telah memasuki kehidupan kita sehari-hari, dan kita berhadapan dengan AI setiap hari. Namun, ketika AI ini diterapkan di bidang medis, keuangan, dan lainnya, kita perlu lebih berhati-hati.

Saat ini, AI dapat membuat keputusan. Ini adalah langkah yang sangat penting dalam proses AI. Ini mengarah ke bagian pertama konten saya: Kami kurang memahami keputusan AI.

Kami kurang menyadari keputusan AI

AI itu seperti kotak hitam. Mereka bisa membuat keputusan sendiri, tapi kita tidak tahu kenapa. Oleh karena itu, yang perlu kita lakukan sekarang adalah membuka "kotak hitam" ini untuk memahami apa yang ingin diungkapkan AI dan keputusan yang mungkin dibuatnya. Inilah tema pidato kita hari ini: bagaimana merancang dan membangun AI yang bertanggung jawab.

Pengembangan AI harus mengikuti prinsip dasar tertentu, termasuk keadilan, transparansi, kepercayaan dan keamanan, privasi dan keamanan, berbagai aplikasi, dan tanggung jawab.

Setiap kali kami menemukan teknologi baru, kami menghadapi masalah yang sama: bagaimana membuat teknologi lebih andal, aman, dan bertanggung jawab.

Misalnya, ketika manusia memproduksi komponen listrik, mereka akan memiliki catatan inspeksi yang sesuai. Setelah ada masalah, Anda dapat meninjau file operasi untuk menemukan masalahnya. Namun, AI tidak sama. AI tidak memiliki checklist seperti itu, dan kami sering tidak tahu link mana yang bermasalah.

Bangun AI yang dapat ditafsirkan

Gambar di atas merupakan gambaran perubahan interpretabilitas model, sumbu horizontal merepresentasikan interpretabilitas model, dan sumbu vertikal merepresentasikan akurasi prediksi. Dari sumbu horizontal, semakin meluas ke kanan, semakin bisa ditafsirkan model yang kita dapatkan. Dari sudut pandang sumbu vertikal, semakin ke atas ekstensi, semakin tinggi akurasi prediksi sistem. Kami telah menggunakan model linier ini beberapa tahun yang lalu, tetapi saat itu model tersebut tidak disebut AI.

Singkatnya, model tersebut sangat kompleks dan sulit dijelaskan. Selanjutnya, kita dapat menggunakan contoh untuk membuktikan mengapa masalah ini begitu rumit.

Kasus 1: Ekstraksi dan perbandinganKami mencoba menemukan lebih banyak data untuk menguji keakuratan model. Pada tahun 2016, banyak tempat meluncurkan perangkat lunak untuk memprediksi penjahat di masa depan, dan pengadilan telah mulai menggunakan AI untuk membantu pengambilan keputusan selama persidangan. Lebih-lebih, semakin banyak orang akan khawatir tentang apakah algoritme itu bias, mari kita analisis secara detail melalui bagan:

Kurva merah mewakili situasi yang diambil dari model, dan kurva hijau mewakili situasi aktual. Misalnya, bagaimana Anda tahu bahwa orang ini akan melakukan kejahatan lagi? Sekarang mari kita tinjau data masa lalu. Data tersebut menunjukkan bahwa orang ini memiliki riwayat kriminal. Semakin banyak pelanggaran yang dilakukan orang tersebut di masa lalu, semakin besar kemungkinan untuk melakukan kejahatan di masa mendatang. Sampai batas tertentu, ini konsisten dengan hasil yang ditunjukkan pada grafik pertama.

Terlihat dari gambar bahwa tingkat kejahatan penduduk Amerika lebih tinggi, dan tingkat pelanggaran ulang juga lebih tinggi (ditunjukkan dengan warna merah), tetapi ternyata garis hijau menunjukkan sebaliknya. Orang-orang menganggap bahwa orang Afrika-Amerika mudah melakukan kejahatan. , Namun kenyataannya tidak demikian, artinya, meskipun prediksi didasarkan pada fakta, terdapat bias tertentu, jadi berhati-hatilah saat melatih data semacam ini.

Kasus 2: Penjelasan dan penjelasan parsial tidak relevan dengan modelBagaimana kita memahami konten melalui model yang kompleks? Model yang kompleks seperti kotak hitam. Kita memasukkan sesuatu ke dalamnya dan kita mendapatkan sesuatu. Alasan mengapa kami tidak dapat memahami model adalah karena model itu sendiri sangat rumit dan tidak jelas.

Beberapa orang beranggapan bahwa model yang tidak dapat dipahami seperti itu tidak mengejar penjelasan secara keseluruhan, tetapi hanya membutuhkan interpretabilitas parsial, maka masalah-masalah berikut akan muncul.

Seperti yang ditunjukkan pada gambar di atas, akurasi pengenalan modelnya sudah mencapai 5/6, tapi saya masih belum tahu mau apa, apakah itu serak atau serigala. Jika yang Anda butuhkan adalah seekor husky, tetapi Anda membawa pulang serigala, maka masalahnya akan besar. Anda mengira Anda melatih model yang sangat kuat, tetapi ternyata tidak. Inilah yang saya tekankan: interpretabilitas model sangat penting.

Topik 2: Bias AI

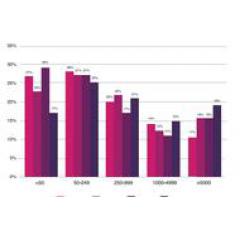

Kasus 1: Prasangka terhadap warna kulit yang berbedaMembangun AI tidak dapat dipisahkan dari data setiap saat. Untuk memahami dari mana bias itu berasal, Anda perlu mengetahui sumber datanya. Dalam algoritma pengenalan wajah yang dikembangkan oleh Microsoft, IBM, dan Face ++, wanita kulit hitam memiliki akurasi pengenalan wajah yang lebih rendah daripada orang kulit putih.

Seperti yang terlihat pada gambar di atas, error rate pengenalan wajah perempuan kulit hitam mencapai 21.073 yang menurut banyak orang tidak dapat diterima. Karena itu, kami telah menyesuaikan model ini. Tiga bulan kemudian, model tersebut diperbaiki dan mendapatkan hasil sebagai berikut:

Dapat dilihat bahwa tingkat akurasi model yang dilatih ulang meningkat secara signifikan saat mengenali orang dengan warna kulit berbeda. Banyak tingkat kesalahan klasifikasi menjadi 0.000. Bahkan untuk wanita kulit hitam, tingkat kesalahan pengenalan juga telah dikurangi menjadi 1.9008. Dari pelatihan berkelanjutan, kami menyimpulkan: Bias ini berasal dari data sampel yang digunakan dalam pelatihan.

Berdasarkan pertanyaan di atas, kami melakukan survei terhadap 500 insinyur pembelajaran mesin Microsoft dan kami bertanya kepada mereka bagaimana cara meningkatkan sistem pembelajaran mesin? Setelah dilakukan investigasi, disimpulkan bahwa: Salah satu masalah terbesar yang dihadapi teknisi machine learning saat ini adalah mereka tahu ada yang tidak beres, tetapi mereka tidak tahu persis apa yang salah atau mengapa itu terjadi.

Saat kami melatih model yang kompleks atau sederhana, kesimpulan akhirnya adalah tingkat akurasinya adalah 73,8%. Saat kami mempelajari setiap kumpulan data pelatihan, kami akan menemukan bahwa warna kulit dan jenis kelamin yang berbeda memiliki tingkat akurasi yang berbeda. Beberapa hasil relatif memuaskan, tetapi sebagian lagi tidak memuaskan.

Jadi, kami membangun sistem untuk membandingkan dan melihat apa yang salah.

Sistem pembelajaran mesin tradisional adalah model tingkat rendah, tetapi model saat ini memiliki interpretabilitas kesalahan. Hal ini dapat dinilai dari perspektif keseluruhan dan berdasarkan karakteristik yang berbeda dari kumpulan data untuk menentukan di mana masalah terjadi, dan itu juga dapat dipahami dari perspektif cluster untuk memahami mengapa hal ini terjadi. masalah. Berdasarkan model ini, setelah terjadi masalah, Anda dapat memeriksa ulang kumpulan data sampel dan model untuk menemukan inti masalahnya.

Kasus 2: Hilangkan prasangka teks yang disematkanKami menggunakan banyak data untuk pelatihan dan mencantumkan 27 pekerjaan, termasuk akuntan, pengacara, guru, arsitek, dll. Kami menyematkan sebuah paragraf, dan menemukan bahwa sistem mengenali pekerjaannya sebagai "guru", tetapi jika kami memodifikasi beberapa kata dalam paragraf, hanya sebagian kecil saja yang akan diubah, dari "dia" menjadi "dia". Tanpa perubahan, hasil pengakuan akhir berubah dari "guru" menjadi "pengacara".

Berikut adalah geometri embedding teks (seperti yang ditunjukkan pada gambar di bawah):

Embedding geometris ini memiliki dua properti: Proximity dan Parallelism. Ketika saya menyebut Apple dan Microsoft di sini, semua orang akan berpikir bahwa pendiri kedua perusahaan itu hebat, dan mereka berdua adalah perusahaan yang sangat besar. Ini adalah konten yang disematkan.

Menurut gambar di atas, jika sebuah kata lebih dekat dengan Dia, itu direpresentasikan sebagai dia; jika sebuah kata lebih dekat dengan Dia, itu direpresentasikan sebagai dia. Dapat dilihat pada sumbu horizontal bahwa semakin banyak kata ke kanan, semakin tidak ada hubungannya dengan gender; semakin ke kiri, semakin terkait dengan gender, seperti istri dan suami, ayah dan ibu. Di sini juga terlihat bahwa ketika berbicara tentang fashion biasanya digunakan untuk mendeskripsikan wanita, dan jika berbicara tentang yang luar biasa, biasanya digunakan untuk mendeskripsikan pria.

Jadi, sekarang kita tahu di mana masalahnya, kita bisa menggunakan model di atas untuk menyelesaikannya. Namun, nanti kita akan menemukan bahwa kata-kata seperti "modis", "luar biasa", dan "jenius" dapat menggambarkan pria dan wanita.

Kita sudah memasuki era AI. Hidup kita sangat erat kaitannya dengan AI. Kita adalah generasi pertama yang terpapar AI. Kita tidak punya pilihan suka atau tidak, tapi kita bisa memutuskan cara membangun dan menggunakan AI.

Akhirnya, terima kasih telah menonton!

Lampiran: Pengantar Shen Xiangyang

Pada November 1996, Shen Xiangyang secara resmi bergabung dengan Microsoft, dan sejak itu memulai karirnya selama 23 tahun di Microsoft. Sebagai eksekutif China dengan waktu layanan terlama dan posisi tertinggi di Microsoft, Shen Xiangyang telah berpartisipasi dalam banyak proyek penting dalam 23 tahun, dan juga menyaksikan semua momen penting dalam perkembangan Microsoft.

Pada 1999, Shen Xiangyang kembali ke Beijing untuk berpartisipasi dalam pendirian Microsoft China Research Institute, dan menjabat sebagai direktur peneliti dan peneliti senior dari Microsoft Research Asia Computing Group; pada 2004, ia dipromosikan menjadi dekan ketiga dan kepala ilmuwan Microsoft Research Asia; pada 2007 , Shen Xiangyang dipromosikan menjadi wakil presiden senior global Microsoft, dan kemudian menjadi wakil presiden eksekutif global Microsoft pada 2013. Pada pagi hari tanggal 14 November 2019, Shen Xiangyang, yang telah bersama Microsoft selama 23 tahun, mengumumkan pengunduran dirinya dari Microsoft.

Shen Xiangyang berfokus pada visi komputer, grafik, interaksi manusia-komputer, pembelajaran statistik, pengenalan pola dan robotika Dia adalah ahli kelas dunia dalam visi komputer dan penelitian grafik.

-

- Pameran Perekrutan Talenta Muda Jinan "Di Udara" diadakan di perusahaan-perusahaan swasta ekonomi terkemuka Ji

-

- Menghancurkan perusahaan dan membuat lebih dari 300 orang menganggur. Bagaimana kami menanggapi serangan ransomware?

-

- Akan ada hujan lebat di Guizhou, Hunan, dan tempat-tempat lain, serta angin kencang dan debu di Gansu barat dan tempat-tempat lain